Plus tôt ce mois-ci, le groupe de travail sur l'intégrité scientifique du Bureau des sciences et technologiques de la Maison Blanche (OSTP) a publié un rapport intitulé «Protection de l'intégrité de la science gouvernementale."Bien que large et globale, le rapport attire l'attention sur les défis particuliers associés à l'intelligence artificielle et à l'apprentissage automatique.

Le rapport de l'OSTP est une réponse à la directive du président Biden pour s'assurer que les législateurs prennent des décisions basées sur des preuves scientifiques et des données dans le but de restaurer la confiance du public au gouvernement.

Le document identifie les principes d'intégrité scientifique et les meilleures pratiques destinées à vérifier que «la science est menée, gérée, communiquée et utilisée de manière à préserver sa précision et son objectivité et la protéger de la suppression, de la manipulation et de l'influence inappropriée, y compris les interférences politiques."

L'avant-propos du rapport - signé par le directeur de l'OSTP, Eric Lander, le directeur adjoint de l'OSTP pour la science et la société Alondra Nelson et le directeur adjoint de l'OSTP pour le climat et l'environnement Jane Lubcheco - énumère les cinq nouveaux principes qui guideront la politique d'intégrité scientifique de l'agence:

Ceux-ci s'appuient sur les six principes originaux définis par l'administration Obama [i] en 2009.

Le rapport cite des thèmes clés supplémentaires que les politiques d'intégrité scientifique devraient aborder, telles que l'amélioration de la diversité, de l'équité, de l'inclusion et de l'accessibilité (DEIA) et de l'amélioration du biais potentiel dans l'intelligence artificielle et l'apprentissage automatique.

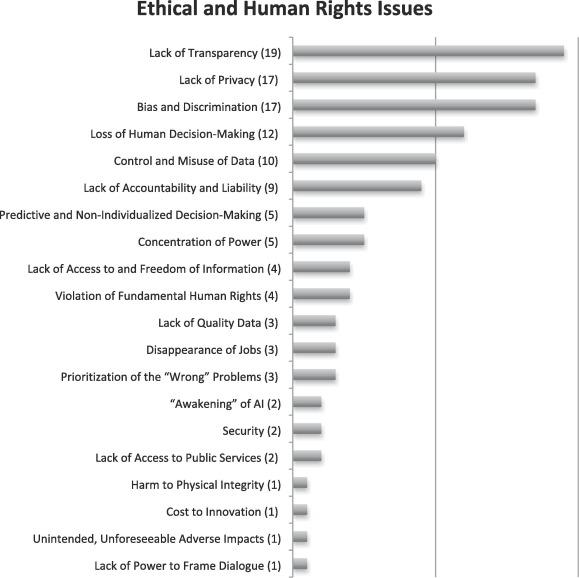

Le rapport reconnaît: «Les algorithmes AI et ML peuvent agrandir les biais inhérents à la source de données sous-jacente et peuvent contenir leurs propres biais inhérents qui conduisent à des conclusions, des conclusions et des décisions politiques inexactes.Le manque de transparence dans les algorithmes ML peut saper la confiance dans les résultats générés et finalement en science et gouvernement.La concentration des données et des capacités de l'IA entre les mains du gouvernement fédéral et des organisations du secteur privé peut créer des inégalités dans qui peut mener des recherches de pointe et qui peut accéder et utiliser les résultats de ces travaux."

Le groupe de travail conseille que les politiques d'intégrité scientifique devraient aider à garantir que:

OSTP prévoit d'utiliser les données du rapport pour créer un plan à court terme pour évaluer et améliorer les politiques d'intégrité scientifique que les dirigeants de l'agence peuvent déployer au sein de leurs organisations.

Le groupe de travail sur l'intégrité scientifique s'est formé en mai 2021 et comprend 57 membres de 29 agences.Le groupe de travail «traite des actions à court terme et à haute priorité pour renforcer l'intégrité scientifique et jette également les bases de la coordination à plus long terme des efforts d'intégrité scientifique d'agence fédérale."

[i] Les six principes originaux sont:

Topics:AI, Compliance, Diversity, Research, StandardsSectors:Academia & Research, GovernmentTags:artificial intelligence, government, machine learning, science, scientific integrity