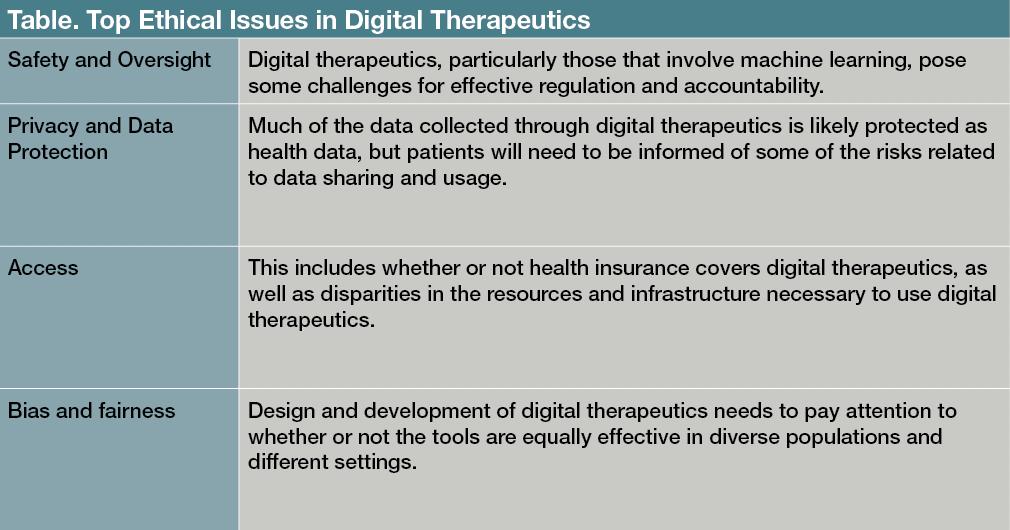

À mesure que les thérapies numériques deviennent de plus en plus populaires, il est important d'examiner comment elles peuvent être intégrées aux soins de santé mentale de manière éthique. La voie à suivre nécessite une attention continue à la fois à une surveillance et à des modèles de soins appropriés, ainsi qu'aux questions de protection des données et de justice.

Problèmes de sécurité et de surveillance

Les principales préoccupations éthiques concernant les technologies numériques de santé mentale ont été la sécurité, la responsabilité, la confidentialité, la protection des données, la transparence, le consentement, les préjugés et l'équité (

Tableau

).

1-3

De nombreuses applications de santé mentale grand public ne sont pas réglementées, et il y a eu

préoccupations connexes concernant le manque de données probantes

pour les applications de santé mentale grand public.

4

Les thérapies numériques sont réglementées en tant que dispositifs médicaux, c'est pourquoi la Food and Drug Administration (FDA) des États-Unis assure la surveillance de la sécurité et de l'efficacité. Cependant, la formulation et la mise en œuvre de mesures de contrôle de la qualité pour les algorithmes utilisés en thérapeutique numérique restent difficiles, tout comme l'évaluation des éléments externes nécessaires (c'est-à-dire les systèmes d'exploitation ou la connectivité) pour fournir une thérapeutique numérique. De nombreuses thérapies numériques sont destinées à évoluer en permanence, ce qui peut nécessiter une réévaluation après une certification initiale.

le

Pré-certification de logiciel numérique de la FDA

Le programme certifie les entreprises qui ont « une solide culture de la qualité et de l'excellence organisationnelle », puis leur offre un processus simplifié d'approbation des produits.

5

Ce programme vise à relever les défis de la réglementation des outils numériques, mais il a été critiqué pour avoir fourni des normes moins strictes que celles utilisées pour les produits pharmaceutiques (par exemple, manque de clarté concernant les critères d'évaluation et une définition complète de l'excellence). Les critiques ont également appelé à

une meilleure responsabilisation pour le maintien des normes

.

6

La réglementation des dispositifs médicaux aux États-Unis et en Europe se concentre sur le produit : l'outil numérique lui-même. Cependant, il est important de reconnaître qu'un outil numérique sera utilisé dans le contexte d'un système de prestation de soins de santé, à des fins et objectifs spécifiés au sein de ce système, peut-être dans le cadre d'un plan d'allocation des ressources disponibles ou de traitement d'une population de patients particulière. Par conséquent, afin d'évaluer adéquatement la sécurité et l'efficacité d'un outil numérique,

une vue système sur la façon dont cet outil sera utilisé

est également nécessaire.

sept

Les outils numériques qui reposent sur l'apprentissage automatique présentent des défis supplémentaires pour la réglementation. Avec

algorithmes d'apprentissage automatique

, il peut être difficile de déterminer pourquoi des entrées de données spécifiques ont conduit à un certain résultat ou à certains résultats.

8

Par conséquent, il peut être difficile d'évaluer et de résoudre les problèmes systématiques dans les extrants, tels que

biais qui ont un impact disproportionné sur différentes populations

.

9,10

Il y a

efforts pour développer des algorithmes

qui sont plus explicables, mais les meilleures pratiques pour identifier et traiter les biais potentiels évoluent encore.

11

Il y a eu des appels pour plus de transparence dans les algorithmes de santé, tels que les développeurs permettant un examen des algorithmes par des tiers. Il est également important que les cliniciens réfléchissent soigneusement à la manière de transmettre les risques et les limites des outils thérapeutiques numériques aux patients à des fins de consentement éclairé. Les cliniciens eux-mêmes peuvent avoir besoin d'une formation pour comprendre les limites potentielles de ces outils numériques. Impliquer les parties prenantes concernées, des cliniciens aux patients et aux membres de la communauté, dans les plans d'adoption et de mise en œuvre de thérapies numériques dans un système de soins de santé, peut également être utile pour répondre aux problèmes d'équité.

Confidentialité et protection des données

Les données sur la santé mentale sont largement

considéré comme plus sensible et potentiellement stigmatisant

que les autres données de santé.

12

L'année dernière, une faille de sécurité des données dans

une application de psychothérapie populaire en Finlande a été exploitée par des pirates informatiques

, qui a ensuite fait chanter des milliers d'utilisateurs sur leurs données personnelles.

13

Cet incident a mis en évidence à la fois la valeur des informations comportementales et l'importance de mesures solides de sécurité des données. Afin de faciliter la télésanté pendant la pandémie, le Bureau des droits civils du ministère de la Santé et des Services sociaux a modifié le

Règle de confidentialité de la loi HIPAA (Health Insurance Portability and Accountability Act)

éliminer les pénalités pour les violations commises de bonne foi dans la prestation de télésanté.

14

Bien que cette disposition et cette clémence soient censées mettre fin à la pandémie, il y aura une tension continue entre l'accessibilité offerte par la technologie numérique, l'exposition potentielle des données des patients par le biais de ces outils et un équilibre approprié entre les problèmes de responsabilité et de responsabilité.

Les données recueillies grâce à la thérapie numérique seraient généralement soumises à la loi HIPAA, qui

établit des protections pour les informations de santé utilisées par les entités couvertes

(c.-à-d. les fournisseurs de soins de santé, les plans de santé et les centres d'échange de soins de santé).

15

le

Technologie de l'information sur la santé pour l'économie

et Clinical Health Act exige en outre que les associés commerciaux d'une entité couverte par la HIPAA se conforment à la règle de sécurité HIPAA.

16,17

Il y a eu des incidents où des associés n'ont pas

protéger adéquatement les données personnelles

.

18

Les thérapies numériques qui sont prescrites par les entités couvertes doivent avoir conclu des accords d'associés commerciaux avec l'entreprise de thérapies numériques et ses associés qui incluent des dispositions pour la conformité.

Le courtage de données est une industrie de 200 milliards de dollars ; ainsi, le paysage actuel du courtage et du partage de données présente

préoccupations supplémentaires pour la protection des données des patients

.

19

Analyse informatique

permettent de tirer des inférences de santé comportementale à partir d'informations apparemment sans rapport (c'est-à-dire des données de localisation), et ces inférences peuvent avoir des ramifications négatives pour les patients (c.

20-23

Bien que seulement

données anonymisées

(les données dont 18 identifiants spécifiques, y compris le nom et l'âge ont été supprimés) peuvent être partagées sans restriction en vertu de la loi HIPAA,

24

les progrès de l'informatique et la disponibilité de grandes bases de données publiques rendent

ré-identification des données personnelles

plus facile et plus possible.

25,26

Ainsi, les données anonymisées du patient qui sont partagées avec des tiers pourraient être ultérieurement réidentifiées et utilisées de manière à ce que le patient

peut ne pas avoir prévu ou prévu

.

27

Un nombre croissant de juridictions ont envisagé de mettre en œuvre des réglementations relatives aux données personnelles et biométriques, telles que la

Règlement général sur la protection des données dans l'Union européenne ou le California Consumer Privacy Act

.

28

Dans ce contexte, les patients des cliniciens ont besoin d'apprécier les risques et les avantages liés aux données collectées grâce à la thérapie numérique ; ces informations devraient être transmises par le biais d'un processus de consentement éclairé.

De plus, certaines thérapies numériques surveillent en permanence les patients, collectant une grande quantité de données personnelles. D'autres études devraient évaluer l'impact de la surveillance omniprésente sur les patients et l'alliance thérapeutique.

Biais et équité dans la thérapeutique numérique

le

Pandémie de covid-19

, ainsi que les récents mouvements de justice sociale, ont mis en lumière

biais et iniquités dans le système de santé

.

29,30

À cause de

injustices historiques vécues par les personnes noires et latines dans les soins de santé

, ces groupes sont plus susceptibles d'exprimer des préoccupations concernant la confidentialité et la qualité de la santé mentale numérique.

31

Le passage à la télésanté a démontré que toutes les communautés ou populations n'ont pas les ressources ou l'infrastructure pour tirer parti des outils numériques. Les centres de santé mentale communautaires, qui desservent de manière disproportionnée les patients noirs et latins, sont moins susceptibles d'avoir l'équipement nécessaire.

30

Si les thérapies numériques doivent tenir la promesse d'un accès accru,

des améliorations sont nécessaires

dans l'infrastructure, la formation et la disponibilité de la supervision des cliniciens pour mieux servir les populations à faible revenu.

32

Des ressources associées, telles qu'une connexion Internet ou du matériel, peuvent également être nécessaires.

Apprentissage automatique

et les technologies de santé numériques soulèvent également des problèmes de préjugés raciaux et d'équité.

33,34

Il existe différents types de biais, tels qu'un ajustement inadéquat entre les données collectées et l'objectif de la recherche, des ensembles de données qui n'ont pas d'échantillons représentatifs de la population cible et des outils numériques qui produisent des effets disparates en fonction de leur mise en œuvre.

35,36

Si la population de recherche pour créer les outils n'est pas suffisamment représentative des divers contextes dans lesquels les thérapies numériques seront utilisées, cela peut conduire à de pires résultats pour certains groupes ou communautés. Il existe un certain nombre d'approches pour lutter contre les biais dans les outils de santé numériques, telles que les correctifs technologiques dans les ensembles de données et les algorithmes, ou en décrivant les principes d'équité dans les outils algorithmiques.

Ce sont des mesures importantes, mais il doit y avoir un effort plus large pour détecter les façons dont les inégalités sociales peuvent façonner le développement et l'efficacité des outils numériques de santé mentale.

37

Bien que les thérapies numériques soient réglementées, il est important de noter que la FDA n'a pas exigé de données concernant la diversité des données de formation pour l'apprentissage automatique. Dans une étude sur les dispositifs de soins de santé d'apprentissage automatique approuvés par la FDA, les enquêteurs ont découvert que la plupart des 130 outils approuvés n'indiquaient pas s'ils avaient été

évalué sur plus d'un site

, et seulement 17 ont fourni des évaluations de sous-groupes démographiques dans leurs soumissions.

38

Étant donné que les données collectées à partir de certaines thérapies numériques peuvent également être utilisées à des fins de recherche en santé, des outils numériques d'une efficacité limitée ou accessibles à des populations sélectionnées pourraient exacerber les inégalités de soins de santé existantes.

Les développeurs, les chercheurs et les cliniciens doivent considérer les

utilisabilité et accessibilité des thérapies numériques

pour les populations culturellement diverses et les groupes marginalisés.

39

Les thérapies numériques doivent être évaluées sur la façon dont leurs conceptions et stratégies de mise en œuvre prennent en compte les besoins de diverses populations (par exemple, des individus de divers groupes d'âge, races, sexe, origines linguistiques et statut de handicap). L'engagement de diverses parties prenantes est essentiel pour fournir des soins de santé mentale équitables et éviter une fracture numérique plus profonde dans l'accès. Les recherches futures devraient éclairer les meilleures pratiques, en particulier en ce qui concerne la façon dont les thérapies numériques interagissent avec la prestation de services de santé mentale dans des contextes réels

.Pensées de conclusion

La télésanté et les thérapies numériques sont très prometteuses pour améliorer les soins aux personnes atteintes de maladie mentale. Il est cependant important que nous cherchions à intégrer les outils numériques dans les soins de santé mentale de manière à soutenir, plutôt qu'à perturber, la relation thérapeutique et à fournir des soins équitables.

40-42

Au niveau des systèmes et des politiques, un financement et des ressources sont nécessaires pour fournir des soins aux différents besoins de santé mentale ainsi que pour élargir l'accès à des soins de haute qualité pour les groupes marginalisés. De tels efforts nécessiteront une attention particulière à une série de questions, y compris le remboursement, l'infrastructure et le développement de modèles de soins appropriés (par exemple, des modèles de soins par étapes).

43

Thérapie numérique

soulever des questions sur les lignes de surveillance ou de responsabilité appropriées

; elles ont potentiellement un impact sur la nature des relations fiduciaires impliquées.

44

Des cadres sur la façon dont les thérapies numériques peuvent aborder les soins préventifs, les patients en crise ou les populations particulières (par exemple, ceux qui souffrent d'une maladie mentale grave) doivent également être développés et mis en œuvre. Si nous pouvons relever ces défis éthiques, alors la thérapie numérique fournira des soins de santé mentale non seulement innovants, mais également équitables.

Dr Martinez-Martin

est professeur adjoint au Stanford Center for Biomedical Ethics et au Département de pédiatrie. Elle a un poste secondaire au département de psychiatrie de la faculté de médecine de l'université de Stanford.

Les références

1. Martinez-Martin N, Dasgupta I, Carter A, et al.

Éthique de la santé mentale numérique pendant COVID-19 : crise et opportunités.

JMIR Santé mentale

. 2020;7(12):e23776.

2. Bauer M, Glenn T, Monteith S, et al.

Perspectives éthiques sur la recommandation de la technologie numérique pour les patients atteints de maladie mentale.

Int J Trouble bipolaire

. 2017;5(1):6.

3. Torous J, Roberts LW.

L'utilisation éthique de la technologie de la santé mobile en psychiatrie clinique.

J Nerv Ment Dis

. 2017;205(1):4-8.

4. Weisel KK, Fuhrmann LM, Berking M, et al.

Applications pour smartphones autonomes pour la santé mentale - une revue systématique et une méta-analyse.

Chiffre NPJ moyen

. 2019;2:118.

5. US Food and Drug Administration. Programme de précertification (pré-cert) des logiciels de santé numérique. 11 septembre 2020. Consulté le 21 avril 2021.

https://www.fda.gov/medical-devices/digital-health-center-excellence/digital-health-software-precertification-pre-cert-program

6. Warren E, Murray P, Smith T. Lettre à la FDA sur la réglementation des logiciels en tant que dispositifs médicaux ; 2018. 10 octobre 2018. Consulté le 6 juillet 2021.

https://www.warren.senate.gov/oversight/letters/warren-murray-smith-press-fda-on-oversight-of-digital-health-devices

7. Gerke S, Babic B, Evgeniou T, Cohen IG.

Le besoin d'une vue système pour réguler les logiciels basés sur l'intelligence artificielle/l'apprentissage automatique en tant que dispositif médical.

Chiffre NPJ moyen

. 2020;3:53.

8. Magrabi F, Ammenwerth E, McNair JB, et al.

L'intelligence artificielle dans l'aide à la décision clinique : défis pour l'évaluation de l'IA et implications pratiques.

Annéeb Med Informer

. 2019;28(1):128-134.

9. Challen R, Denny J, Pitt M, et al.

Intelligence artificielle, biais et sécurité clinique.

BMJ Qual Saf

. 2019;28(3):231-237.

10. Obermeyer Z, Pouvoirs B, Vogeli C, Mullainathan S.

Disséquer les préjugés raciaux dans un algorithme utilisé pour gérer la santé des populations.

La science

. 2019;366(6464):447-453.

11. Amann J, Blasimme A, Vayena E, et al.

L'explicabilité de l'intelligence artificielle dans les soins de santé : une perspective multidisciplinaire.

BMC Med Informer Décis Mak

. 2020;20(1):310.

12. Aitken M, de St Jorre J, Pagliari C, et al.

Réponses du public au partage et au couplage de données sur la santé à des fins de recherche : une revue systématique et une synthèse thématique d'études qualitatives.

Éthique BMC Med

. 2016;17(1):73.

13. Ralston W. Ils ont tout dit à leurs thérapeutes. Les pirates ont tout divulgué.

Filaire

. 4 mai 2021. Consulté le 13 juin 2021.

https://www.wired.com/story/vastaamo-psychotherapy-patients-hack-data-breach

14. Département américain de la Santé et des Services sociaux. Notification du pouvoir discrétionnaire d'application pour les communications à distance de télésanté pendant l'urgence de santé publique à l'échelle nationale COVID-19. 17 mars 2020. Consulté le 24 avril 2020.

https://www.hhs.gov/hipaa/for-professionals/special-topics/emergency-preparedness/notification-enforcement-discretion-telehealth/index.html

15. Congrès.gov. Loi de 1996 sur la transférabilité et la responsabilité en matière d'assurance maladie. Loi publique 104-191. 21 août 1996. Consulté le 15 juillet 2021.

https://www.congress.gov/104/plaws/publ191/PLAW-104publ191.pdf

16. Département américain de la Santé et des Services sociaux. Règle finale provisoire d'application de la loi HITECH. Révisé le 16 juin 2017. Consulté le 15 juillet 2021.

https://www.hhs.gov/hipaa/for-professionals/special-topics/hitech-act-enforcement-interim-final-rule/index.html

17. Perakslis éd.

Cybersécurité dans les soins de santé.

N Anglais J Med

. 2014;371(5):395-397.

18. Rothstein MA. Débat sur le contrôle de la vie privée des patients dans les dossiers de santé électroniques. Hastings Center, Bioethics Forum, 2011. Mis à jour le 5 février 2014. Consulté le 6 juillet 2021.

https://papers.ssrn.com/sol3/papers.cfm?abstract_id=1764002

19. Crain M.

Les limites de la transparence : data brokers et marchandisation

.

Nouveaux médias et société

. 2018;20(1):88-104.

20. Allen M. Les assureurs-maladie recherchent des détails sur vous – et cela pourrait augmenter vos tarifs.

ProPublica

. 17 juillet 2018. Consulté le 6 juillet 2021.

https://www.propublica.org/article/health-insurers-are-vacuuming-up-details-about-you-and-it-could-raise-your-rates

21. Wachter S.

La protection des données à l'ère des mégadonnées.

Nature Électronique

. 2019;2(1):6-7.

22. Skiljic A. Le statu quo des inférences de données sur la santé. Association internationale des professionnels de la protection de la vie privée : Perspectives de la vie privée. 19 mars 2021. Consulté le 6 juillet 2021.

https://iapp.org/news/a/the-status-quo-of-health-data-inferences/

23. Kröger JL, Raschke P, Bhuiyan TR.

Implications sur la confidentialité des données de l'accéléromètre : un examen des inférences possibles.

Dans:

Actes de la 3e Conférence internationale sur la cryptographie, la sécurité et la confidentialité

. ICCSP '19. Association pour les machines informatiques ; 2019 : 81-87.

24. Désidentification des informations de santé protégées : comment anonymiser les RPS.

Journal HIPAA

. 18 octobre 2017. Consulté le 6 juillet 2021.

https://www.hipaajournal.com/de-identification-protected-health-information/

25. Benitez K, Malin B.

Évaluer les risques de ré-identification par rapport à la règle de confidentialité HIPAA.

J Am Med Informer Assoc.

2010;17(2):169-77.

26. Yoo JS, Thaler A, Sweeney L, Zang J. Risques pour la vie privée des patients : une ré-identification des patients dans les données hospitalières du Maine et du Vermont.

Technologie Science

. 9 octobre 2018. Consulté le 6 juillet 2021.

https://techscience.org/a/2018100901/

27. Culnane C, Rubinstein BIP, Teague V. Données de santé dans un monde ouvert. L'Université de Cornell. L'informatique. 15 décembre 2017. Consulté le 6 juillet 2021.

http://arxiv.org/abs/1712.05627

28. California Consumer Privacy Act of 2018 [1798.100-1798.199.100]. Informations législatives californiennes. Mis à jour le 3 novembre 2020. Consulté le 15 juillet 2021.

https://leginfo.legislature.ca.gov/faces/codes_displayText.xhtml?division=3.&part=4.&lawCode=CIV&title=1.81.5

29. Webb Hooper M, Nápoles AM, Pérez-Stable EJ.

COVID-19 et disparités raciales/ethniques.

JAMA

. 2020;323(24):2466-2467.

30. van Deursen AJ.

Inégalité numérique pendant une pandémie : étude quantitative des différences dans les utilisations d'Internet liées au COVID-19 et les résultats parmi la population générale.

J Med Internet Res

. 2020;22(8):e20073.

31. George S, Hamilton A, Baker RS.

Que pensent les Afro-Américains et les Latinos urbains à faible revenu de la télémédecine ? Une diffusion de l'analyse de l'innovation.

Int J Telemed Appl

. 2012;2012:715194.

32. Conrad R, Rayala H, Diamond R, et al. Développer la télésanté mentale en réponse à la pandémie de COVID-19.

Horaires psychiatriques

. 7 avril 2020. Consulté le 6 juillet 2021.

https://www.psychiatrictimes.com/view/expanding-telemental-health-response-covid-19-pandemic

33. Rajkomar A, Hardt M, Howell MD, et al.

Garantir l'équité dans l'apprentissage automatique pour faire progresser l'équité en santé.

Ann Stagiaire Med

. 2018;169(12):866-872.

34. Gerke S, Minssen T, Cohen G.

Défis éthiques et juridiques des soins de santé basés sur l'intelligence artificielle.

Dans : Bohr A, Memarzadeh K, éd.

L'intelligence artificielle dans les soins de santé

. Elsevier ;2020 : 295-336.

35. Char DS, Shah NH, Magnus D.

Mettre en œuvre l'apprentissage automatique dans les défis éthiques liés aux soins de santé.

N Anglais J Med

. 2018;378(11):981-983.

36. Binns R. L'équité dans l'apprentissage automatique : leçons de la philosophie politique. L'Université de Cornell. L'informatique. Mis à jour le 23 mars 2021. Consulté le 6 juillet 2021.

http://arxiv.org/abs/1712.03586

.

37. Mittelstadt B.

Les principes à eux seuls ne peuvent garantir une IA éthique.

Nat Mach Intell

. 2019;1(11):501-507.

38. Wu E, Wu K, Daneshjou R, et al.

Comment les dispositifs médicaux d'IA sont évalués : limites et recommandations d'une analyse des approbations de la FDA.

Nat Med

. 2021;27(4):582-584.

39. Martschenko D, Martinez-Martin N.

Qu'en est-il de l'éthique dans la bioéthique du design ?

Suis J Bioeth

. 2021;21(6):61-63.

40. Martinez-Martin N, Dunn LB, Roberts LW.

Est-il éthique d'utiliser des estimations pronostiques issues de l'apprentissage automatique pour traiter la psychose ?

Éthique AMA J

. 2018;20(9):E804-811.

41. Potier R.

Le projet de phénotypage numérique : une perspective psychanalytique et théorie des réseaux.

Psychol avant

. 2020;11:1218.

42. Dagum P, Montag C.

Considérations éthiques du phénotypage numérique du point de vue d'un professionnel de la santé.

Dans : Baumeister H, Montag C, éd.

Phénotypage numérique et détection mobile : nouveaux développements en psycho-informatique.

Éditions internationales Springer ; 2019 : 13-28.

43. Taylor CB, Fitzsimmons-Craft EE, Graham AK.

La technologie numérique peut révolutionner la prestation des services de santé mentale : la crise du COVID-19 comme catalyseur de changement.

Int J Eat Disord

. 2020;53(7):1155-1157.

44. Cohen IG, Amarasingham R, Shah A, et al.

Les problèmes juridiques et éthiques qui découlent de l'utilisation d'analyses prédictives complexes dans les soins de santé.

Santé Aff (Millwood)

. 2014;33(7):1139-1147.