L'étiquetage des données peut être une corvée. C'est la principale source de subsistance pour les modèles de vision par ordinateur; sans cela, ils auraient beaucoup de difficulté à identifier les objets, les personnes et d'autres caractéristiques importantes de l'image. Pourtant, la production d'une heure seulement de données balisées et étiquetées peut prendre 800 heures de temps humain. Notre compréhension haute fidélité du monde se développe à mesure que les machines peuvent mieux percevoir et interagir avec notre environnement. Mais ils ont besoin de plus d'aide.

Des scientifiques du laboratoire d'informatique et d'intelligence artificielle (CSAIL) du MIT, de Microsoft et de l'université Cornell ont tenté de résoudre ce problème qui afflige les modèles de vision en créant "STEGO", un algorithme qui peut découvrir et segmenter conjointement des objets sans aucune étiquette humaine à tout, jusqu'au pixel près.

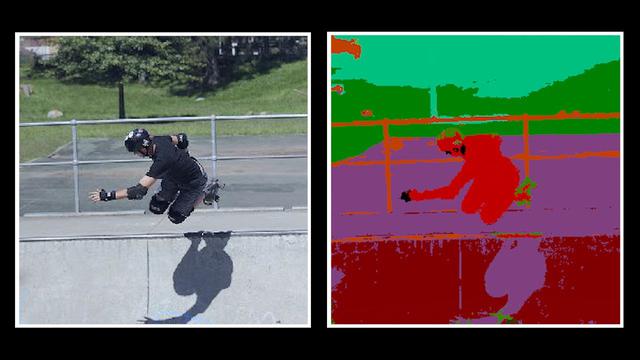

STEGO apprend ce qu'on appelle la "segmentation sémantique" - un langage fantaisiste pour le processus d'attribution d'une étiquette à chaque pixel d'une image. La segmentation sémantique est une compétence importante pour les systèmes de vision par ordinateur d'aujourd'hui, car les images peuvent être encombrées d'objets. Encore plus difficile est que ces objets ne rentrent pas toujours dans des boîtes littérales ; les algorithmes ont tendance à mieux fonctionner pour des « choses » discrètes comme les personnes et les voitures, par opposition à des « choses » comme la végétation, le ciel et la purée de pommes de terre. Un système précédent pouvait simplement percevoir une scène nuancée d'un chien jouant dans le parc comme un simple chien, mais en attribuant une étiquette à chaque pixel de l'image, STEGO peut décomposer l'image en ses principaux ingrédients : un chien, un ciel, de l'herbe et son propriétaire.