A medida que las terapias digitales se vuelven más populares, es importante considerar cómo pueden integrarse en la atención de la salud mental de manera ética. El camino a seguir requiere una atención continua tanto a la supervisión y los modelos de atención adecuados, como a las cuestiones de protección de datos y justicia.

Problemas de seguridad y supervisión

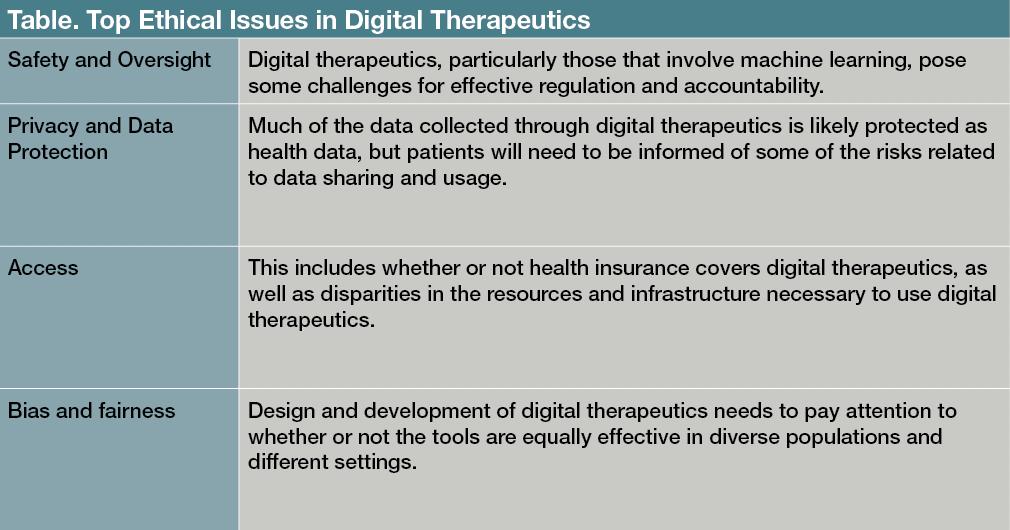

Las principales preocupaciones éticas de la tecnología digital de salud mental han sido la seguridad, la responsabilidad, la privacidad, la protección de datos, la transparencia, el consentimiento y el sesgo y la equidad (

Mesa

).

1-3

Muchas aplicaciones de salud mental para consumidores no están reguladas y ha habido

preocupaciones relacionadas con respecto a la falta de base de pruebas

para aplicaciones de salud mental para consumidores.

4

Las terapias digitales están reguladas como dispositivos médicos, por lo que la Administración de Drogas y Alimentos de los Estados Unidos (FDA) supervisa la seguridad y la eficacia. Sin embargo, la formulación e implementación de medidas de control de calidad para los algoritmos utilizados en la terapéutica digital sigue siendo un desafío, al igual que la evaluación de los elementos externos necesarios (es decir, los sistemas operativos o la conectividad) para proporcionar la terapéutica digital. Muchas terapias digitales están destinadas a evolucionar continuamente, lo que puede significar que deben volver a evaluarse después de una certificación inicial.

El

Precertificación de software digital de la FDA

El programa certifica a las empresas que tienen “una cultura sólida de calidad y excelencia organizacional” y luego les brinda un proceso simplificado para la aprobación de productos.

5

Este programa está destinado a abordar los desafíos de regular las herramientas digitales, pero ha sido criticado por proporcionar estándares menos estrictos que los utilizados para los productos farmacéuticos (p. Ej., Falta de claridad con respecto a los criterios de evaluación y una definición completa de excelencia). Los críticos también han pedido

responsabilidad mejorada para mantener los estándares

.

6

La regulación de los dispositivos médicos en Estados Unidos y Europa se centra en el producto: la propia herramienta digital. Sin embargo, es importante reconocer que una herramienta digital se utilizará dentro del contexto de un sistema de prestación de servicios de salud, para propósitos y objetivos especificados dentro de ese sistema, tal vez como parte de un plan para asignar los recursos disponibles o para tratar a una población de pacientes en particular. Por tanto, para evaluar adecuadamente la seguridad y eficacia de una herramienta digital,

una visión de los sistemas sobre cómo se utilizará esa herramienta

también es necesario.

7

Las herramientas digitales que se basan en el aprendizaje automático presentan desafíos adicionales para la regulación. Con

algoritmos de aprendizaje automático

, puede ser difícil determinar por qué las entradas de datos específicos llevaron a una determinada salida o resultados.

8

En consecuencia, puede ser difícil evaluar y abordar problemas sistemáticos en los productos, como

Sesgos que impactan desproporcionadamente a diferentes poblaciones.

.

9,10

Existen

esfuerzos para desarrollar algoritmos

que son más explicables, pero las mejores prácticas para identificar y abordar posibles sesgos aún están evolucionando.

11

Se han pedido más transparencia en los algoritmos de salud, como los desarrolladores que permiten la revisión de algoritmos por parte de terceros. También es importante que los médicos consideren detenidamente cómo transmitir los riesgos y las limitaciones de las herramientas terapéuticas digitales a los pacientes con fines de consentimiento informado. Los propios médicos pueden necesitar formación para comprender las posibles limitaciones de estas herramientas digitales. Involucrar a las partes interesadas relevantes, desde médicos hasta pacientes y miembros de la comunidad, en los planes para la adopción e implementación de terapias digitales en un sistema de atención médica, también puede ser útil para abordar los problemas de equidad.

Privacidad y protección de datos

Los datos de salud mental son ampliamente

visto como más sensible y potencialmente estigmatizante

que otros datos de salud.

12

El año pasado, una falla en la seguridad de los datos

una aplicación de psicoterapia popular en Finlandia fue explotada por piratas informáticos

, que luego chantajeó a miles de usuarios por sus datos personales.

13

Este incidente destacó tanto el valor de la información de comportamiento como la importancia de fuertes medidas de seguridad de datos. Para facilitar la telesalud durante la pandemia, la Oficina de Derechos Civiles del Departamento de Salud y Servicios Humanos modificó la

Regla de privacidad de la Ley de Portabilidad y Responsabilidad del Seguro Médico (HIPAA)

para eliminar las sanciones por infracciones cometidas en la prestación de buena fe de telesalud.

14

Aunque esta disposición e indulgencia está destinada a terminar con la pandemia, habrá una tensión continua entre la accesibilidad que ofrece la tecnología digital, la posible exposición de los datos de los pacientes a través de estas herramientas y el equilibrio adecuado entre la responsabilidad y las preocupaciones sobre la responsabilidad.

Los datos recopilados a través de terapias digitales generalmente estarían sujetos a HIPAA, que

establece protecciones para la información de salud utilizada por las entidades cubiertas

(es decir, proveedores de atención médica, planes de salud y cámaras de compensación de atención médica).

15

El

Tecnología de la información sanitaria para fines económicos

y la Ley de Salud Clínica también requiere que los socios comerciales de una entidad cubierta por HIPAA cumplan con la Regla de Seguridad de HIPAA.

16,17

Ha habido algunos incidentes en los que los socios comerciales no

proteger adecuadamente los datos personales

.

18

Las terapias digitales prescritas por entidades cubiertas deben tener acuerdos de socios comerciales vigentes con la compañía terapéutica digital y sus asociados que incluyan disposiciones para el cumplimiento.

El corretaje de datos es una industria de $ 200 mil millones; por lo tanto, el panorama actual del intercambio y el intercambio de datos presenta

preocupaciones adicionales para la protección de los datos del paciente

.

19

Analítica informática

hacen posible extraer inferencias de salud conductual a partir de información aparentemente no relacionada (es decir, datos de ubicación), y estas inferencias pueden conducir a ramificaciones negativas para los pacientes (es decir, tasas de seguro más altas o discriminación laboral).

20-23

Aunque solo

datos desidentificados

(datos de los cuales se han eliminado 18 identificadores específicos, incluido el nombre y la edad) se pueden compartir sin restricción bajo HIPAA,

24

Los avances en informática y la disponibilidad de grandes bases de datos públicas hacen

reidentificación de datos personales

más fácil y más posible.

25,26

Por lo tanto, los datos del paciente anonimizados que se comparten con terceros podrían volver a identificarse más tarde y usarse de manera que el paciente

puede no haber previsto o esperado

.

27

Un número creciente de jurisdicciones ha considerado implementar regulaciones de datos personales y biométricos, como la

Reglamento general de protección de datos en la Unión Europea o la Ley de privacidad del consumidor de California

.

28

En este contexto, los pacientes de los médicos deben apreciar los riesgos y beneficios relacionados con los datos recopilados a través de la terapéutica digital; esta información debe transmitirse a través de un proceso de consentimiento informado.

Además, algunas terapias digitales monitorean continuamente a los pacientes, recolectando una gran cantidad de datos personales. Los estudios adicionales deben evaluar el impacto de la vigilancia generalizada en los pacientes y la alianza terapéutica.

Sesgo y equidad en la terapéutica digital

El

Pandemia de COVID-19

, así como los recientes movimientos por la justicia social, han puesto de relieve

Sesgos e inequidades en el sistema de salud.

.

29,30

Debido a

injusticias históricas experimentadas por personas negras y latinas en el cuidado de la salud

, es más probable que estos grupos expresen preocupaciones con respecto a la privacidad y la calidad de la salud mental digital.

31

El cambio a la telesalud demostró que no todas las comunidades o poblaciones tienen los recursos o la infraestructura para aprovechar las herramientas digitales. Los centros comunitarios de salud mental, que atienden de manera desproporcionada a pacientes negros y latinos, tienen menos probabilidades de tener el equipo necesario.

30

Si la terapéutica digital debe cumplir la promesa de un mayor acceso,

se necesitan mejoras

en infraestructura, capacitación y disponibilidad de supervisión médica para atender mejor a la demografía de bajos ingresos.

32

Es posible que también se necesiten recursos asociados, como conexión a Internet o hardware.

Aprendizaje automático

y las tecnologías de la salud digital también plantean problemas de prejuicio racial y equidad.

33,34

Existen diferentes tipos de sesgos, como un ajuste inadecuado entre los datos recopilados y el propósito de la investigación, conjuntos de datos que no tienen muestras representativas de la población objetivo y herramientas digitales que producen efectos dispares según la forma en que se implementan.

35,36

Si la población de investigación para la creación de las herramientas no es suficientemente representativa de los diversos contextos en los que se utilizará la terapéutica digital, puede conducir a peores resultados para ciertos grupos o comunidades. Hay una serie de enfoques para abordar el sesgo en las herramientas de salud digital, como las correcciones tecnológicas en conjuntos de datos y algoritmos, o esbozar principios de equidad en herramientas algorítmicas.

Estas son medidas importantes, pero debe haber un esfuerzo más amplio para detectar las formas en que las inequidades sociales pueden moldear el desarrollo y la eficacia de las herramientas digitales de salud mental.

37

Aunque las terapias digitales están reguladas, es importante tener en cuenta que la FDA no ha requerido datos sobre la diversidad en los datos de entrenamiento para el aprendizaje automático. En un estudio de dispositivos para el cuidado de la salud de aprendizaje automático aprobado por la FDA, los investigadores encontraron que la mayoría de las 130 herramientas aprobadas no informaron si habían sido

evaluado en más de 1 sitio

y solo 17 proporcionaron evaluaciones de subgrupos demográficos en sus presentaciones.

38

Debido a que los datos recopilados de algunas terapias digitales también pueden usarse con fines de investigación en salud, las herramientas digitales que tienen una efectividad limitada o son accesibles para poblaciones seleccionadas podrían exacerbar las desigualdades existentes en la atención médica.

Los desarrolladores, investigadores y médicos deben considerar la

usabilidad y accesibilidad de la terapéutica digital

para poblaciones culturalmente diversas y grupos marginados.

39

La terapéutica digital debe evaluarse en función de qué tan bien sus diseños y estrategias de implementación tienen en cuenta las necesidades de diversas poblaciones (por ejemplo, individuos de varios grupos de edad, razas, género, antecedentes lingüísticos y estado de discapacidad). La participación de diversas partes interesadas es vital para brindar una atención de salud mental equitativa y evitar una brecha digital más profunda en el acceso. La investigación futura debe informar las mejores prácticas, particularmente en términos de cómo la terapéutica digital interactúa con la provisión de servicios de salud mental en entornos del mundo real.

Pensamient

os concluyentesLa telesalud y la terapéutica digital son muy prometedoras para mejorar la atención de las personas con enfermedades mentales. Sin embargo, es importante que busquemos integrar las herramientas digitales en la atención de la salud mental de manera que apoyen, en lugar de interrumpir, la relación terapéutica y brinden una atención equitativa.

40-42

A nivel de sistemas y políticas, se necesitan fondos y recursos para brindar atención a las diferentes necesidades de salud mental, así como para ampliar el acceso a una atención de alta calidad para los grupos marginados. Tales esfuerzos requerirán atención a una variedad de cuestiones, incluido el reembolso, la infraestructura y el desarrollo de modelos de atención adecuados (por ejemplo, modelos de atención escalonada).

43

Terapéutica digital

plantear preguntas sobre las líneas apropiadas de supervisión o responsabilidad

; potencialmente impactan la naturaleza de las relaciones fiduciarias involucradas.

44

También es necesario desarrollar e implementar marcos sobre cómo la terapéutica digital puede abordar la atención preventiva, los pacientes en crisis o las poblaciones especiales (por ejemplo, aquellos con enfermedades mentales graves). Si podemos hacer frente a estos desafíos éticos, la terapéutica digital proporcionará no solo una atención de la salud mental innovadora, sino también equitativa.

Dr. Martinez-Martin

es profesor asistente en el Centro de Ética Biomédica de Stanford y en el Departamento de Pediatría. Tiene un puesto de secundaria en el Departamento de Psiquiatría de la Facultad de Medicina de la Universidad de Stanford.

Referencias

1. Martinez-Martin N, Dasgupta I, Carter A, et al.

Ética de la salud mental digital durante el COVID-19: crisis y oportunidades.

JMIR Ment Health

. 2020; 7 (12): e23776.

2. Bauer M, Glenn T, Monteith S, et al.

Perspectivas éticas sobre la recomendación de tecnología digital para pacientes con enfermedades mentales.

Trastorno bipolar Int J

. 2017; 5 (1): 6.

3. Torous J, Roberts LW.

El uso ético de la tecnología de salud móvil en psiquiatría clínica.

J Nerv Ment Dis

. 2017; 205 (1): 4-8.

4. Weisel KK, Fuhrmann LM, Berking M, et al.

Aplicaciones independientes para teléfonos inteligentes para la salud mental: una revisión sistemática y un metanálisis.

NPJ Dígito Med

. 2019; 2: 118.

5. Administración de Drogas y Alimentos de los Estados Unidos. Programa de precertificación (precertificación) de software de salud digital. 11 de septiembre de 2020. Consultado el 21 de abril de 2021.

https://www.fda.gov/medical-devices/digital-health-center-excellence/digital-health-software-precertification-pre-cert-program

6. Warren E, Murray P, Smith T. Carta a la FDA sobre la regulación del software como dispositivo médico; 2018.10 de octubre de 2018. Consultado el 6 de julio de 2021.

https://www.warren.senate.gov/oversight/letters/warren-murray-smith-press-fda-on-oversight-of-digital-health-devices

7. Gerke S, Babic B, Evgeniou T, Cohen IG.

La necesidad de una vista de sistema para regular el software basado en inteligencia artificial / aprendizaje automático como dispositivo médico.

NPJ Dígito Med

. 2020; 3:53.

8. Magrabi F, Ammenwerth E, McNair JB, et al.

Inteligencia artificial en el apoyo a la toma de decisiones clínicas: desafíos para evaluar la IA e implicaciones prácticas.

Yearb Med Inform

. 2019; 28 (1): 128-134.

9. Challen R, Denny J, Pitt M, et al.

Inteligencia artificial, sesgo y seguridad clínica.

BMJ Qual Saf

. 2019; 28 (3): 231-237.

10. Obermeyer Z, Powers B, Vogeli C, Mullainathan S.

Diseccionar el sesgo racial en un algoritmo utilizado para gestionar la salud de las poblaciones.

Ciencias

. 2019; 366 (6464): 447-453.

11. Amann J, Blasimme A, Vayena E, et al.

Explicabilidad para la inteligencia artificial en la salud: una perspectiva multidisciplinar.

BMC Med Inform Decis Mak

. 2020; 20 (1): 310.

12. Aitken M, de St Jorre J, Pagliari C, et al.

Respuestas públicas al intercambio y vinculación de datos de salud con fines de investigación: una revisión sistemática y síntesis temática de estudios cualitativos.

Ética de BMC Med

. 2016; 17 (1): 73.

13. Ralston W. Le contaron todo a sus terapeutas. Los piratas informáticos lo filtraron todo.

Cableado

. 4 de mayo de 2021. Consultado el 13 de junio de 2021.

https://www.wired.com/story/vastaamo-psychotherapy-patients-hack-data-breach

14. Departamento de Salud y Servicios Humanos de EE. UU. Notificación de discreción de aplicación para las comunicaciones remotas de telesalud durante la emergencia de salud pública nacional COVID-19. 17 de marzo de 2020. Consultado el 24 de abril de 2020.

https://www.hhs.gov/hipaa/for-professionals/special-topics/emergency-preparedness/notification-enforcement-discretion-telehealth/index.html

15. Congress.gov. Ley de Portabilidad y Responsabilidad del Seguro Médico de 1996. Ley Pública 104-191. 21 de agosto de 1996. Consultado el 15 de julio de 2021.

https://www.congress.gov/104/plaws/publ191/PLAW-104publ191.pdf

16. Departamento de Salud y Servicios Humanos de EE. UU. Regla final provisional de aplicación de la ley HITECH. Revisado el 16 de junio de 2017. Consultado el 15 de julio de 2021.

https://www.hhs.gov/hipaa/for-professionals/special-topics/hitech-act-enforcement-interim-final-rule/index.html

17. Perakslis ED.

Ciberseguridad en la asistencia sanitaria.

N Engl J Med

. 2014; 371 (5): 395-397.

18. Rothstein MA. Debate sobre el control de la privacidad del paciente en las historias clínicas electrónicas. Hastings Center, Bioethics Forum, 2011. Actualizado el 5 de febrero de 2014. Consultado el 6 de julio de 2021.

https://papers.ssrn.com/sol3/papers.cfm?abstract_id=1764002

19. Crain M.

Los límites de la transparencia: intermediarios de datos y mercantilización

.

Nuevos medios y sociedad

. 2018; 20 (1): 88-104.

20. Allen M. Las aseguradoras de salud están limpiando detalles sobre usted, y eso podría aumentar sus tarifas.

ProPublica

. 17 de julio de 2018. Consultado el 6 de julio de 2021.

https://www.propublica.org/article/health-insurers-are-vacuuming-up-details-about-you-and-it-could-raise-your-rates

21. Wachter S.

Protección de datos en la era del big data.

Electrónica de la naturaleza

. 2019; 2 (1): 6-7.

22. Skiljic A. El statu quo de las inferencias de datos sanitarios. Asociación internacional de profesionales de la privacidad: perspectivas de privacidad. 19 de marzo de 2021. Consultado el 6 de julio de 2021.

https://iapp.org/news/a/the-status-quo-of-health-data-inferences/

23. Kröger JL, Raschke P, Bhuiyan TR.

Implicaciones de privacidad de los datos del acelerómetro: una revisión de posibles inferencias.

En:

Actas de la 3a Conferencia Internacional sobre Criptografía, Seguridad y Privacidad

. ICCSP '19. Asociación para Maquinaria de Computación; 2019: 81-87.

24. Desidentificación de la información médica protegida: cómo anonimizar la PHI.

Revista HIPAA

. 18 de octubre de 2017. Consultado el 6 de julio de 2021.

https://www.hipaajournal.com/de-identification-protected-health-information/

25. Benitez K, Malin B.

Evaluar los riesgos de reidentificación con respecto a la regla de privacidad de HIPAA.

J Am Med Inform Assoc.

2010; 17 (2): 169-77.

26. Yoo JS, Thaler A, Sweeney L, Zang J. Riesgos para la privacidad del paciente: una reidentificación de pacientes en los datos de hospitales estatales de Maine y Vermont.

Ciencia Tecnológica

. 9 de octubre de 2018. Consultado el 6 de julio de 2021.

https://techscience.org/a/2018100901/

27. Culnane C, Rubinstein BIP, Teague V. Datos de salud en un mundo abierto. Universidad de Cornell. Ciencias de la Computación. 15 de diciembre de 2017. Consultado el 6 de julio de 2021.

http://arxiv.org/abs/1712.05627

28. Ley de privacidad del consumidor de California de 2018 [1798.100-1798.199.100]. Información legislativa de California. Actualizado el 3 de noviembre de 2020. Consultado el 15 de julio de 2021.

https://leginfo.legislature.ca.gov/faces/codes_displayText.xhtml?division=3.&part=4.&lawCode=CIV&title=1.81.5

29. Webb Hooper M, Nápoles AM, Pérez-Stable EJ.

COVID-19 y disparidades raciales / étnicas.

JAMA

. 2020; 323 (24): 2466-2467.

30. van Deursen AJ.

Desigualdad digital durante una pandemia: estudio cuantitativo de las diferencias en los usos y resultados de Internet relacionados con COVID-19 entre la población general.

J Med Internet Res

. 2020; 22 (8): e20073.

31. George S, Hamilton A, Baker RS.

¿Cómo se sienten los afroamericanos y latinos urbanos de bajos ingresos acerca de la telemedicina? Una difusión del análisis de la innovación.

Int J Telemed Appl

. 2012; 2012: 715194.

32. Conrad R, Rayala H, Diamond R, et al. Expansión de la salud telemental en respuesta a la pandemia de COVID-19.

Tiempos psiquiátricos

. 7 de abril de 2020. Consultado el 6 de julio de 2021.

https://www.psychiatrictimes.com/view/expanding-telemental-health-response-covid-19-pandemic

33. Rajkomar A, Hardt M, Howell MD, et al.

Garantizar la equidad en el aprendizaje automático para promover la equidad en salud.

Ann Intern Med

. 2018; 169 (12): 866-872.

34. Gerke S, Minssen T, Cohen G.

Desafíos éticos y legales de la atención médica impulsada por inteligencia artificial.

En: Bohr A, Memarzadeh K, eds.

Inteligencia artificial en la salud

. Elsevier; 2020: 295-336.

35. Char DS, Shah NH, Magnus D.

Implementar el aprendizaje automático en la atención médica para abordar los desafíos éticos.

N Engl J Med

. 2018; 378 (11): 981-983.

36. Binns R. Equidad en el aprendizaje automático: lecciones de la filosofía política. Universidad de Cornell. Ciencias de la Computación. Actualizado el 23 de marzo de 2021. Consultado el 6 de julio de 2021.

http://arxiv.org/abs/1712.03586

.

37. Mittelstadt B.

Los principios por sí solos no pueden garantizar una IA ética.

Nat Mach Intell

. 2019; 1 (11): 501-507.

38. Wu E, Wu K, Daneshjou R, et al.

Cómo se evalúan los dispositivos médicos de IA: limitaciones y recomendaciones de un análisis de las aprobaciones de la FDA.

Nat Med

. 2021; 27 (4): 582-584.

39. Martschenko D, Martinez-Martin N.

¿Qué pasa con la ética en la bioética del diseño?

Soy J Bioeth

. 2021; 21 (6): 61-63.

40. Martínez-Martin N, Dunn LB, Roberts LW.

¿Es ético utilizar estimaciones de pronóstico del aprendizaje automático para tratar la psicosis?

Ética AMA J

. 2018; 20 (9): E804-811.

41. Potier R.

El proyecto de fenotipado digital: una perspectiva psicoanalítica y teórica de redes.

Psychol delantero

. 2020; 11: 1218.

42. Dagum P, Montag C.

Consideraciones éticas del fenotipado digital desde la perspectiva de un médico.

En: Baumeister H, Montag C, eds.

Fenotipado digital y detección móvil: nuevos avances en psicoinformática.

Springer International Publishing; 2019: 13-28.

43. Taylor CB, Fitzsimmons-Craft EE, Graham AK.

La tecnología digital puede revolucionar la prestación de servicios de salud mental: la crisis de COVID-19 como catalizador del cambio.

Int J Eat Disord

. 2020; 53 (7): 1155-1157.

44. Cohen IG, Amarasingham R, Shah A, et al.

Las preocupaciones legales y éticas que surgen del uso de análisis predictivos complejos en el cuidado de la salud.

Salud Aff (Millwood)

. 2014; 33 (7): 1139-1147.